|

반면 인공지능의 핵심인 신경망 모사에 있어서는 각 연산분야별 우선순위가 크게 변한다. 인간의 두뇌가 그러하듯 개별 연산의 정밀도는 다소 떨어지더라도 이를 압도적인 수량으로 병렬 처리해 그로부터 일정한 ‘패턴’을 도출하는 것. 이를 우리는 ‘학습’ 또는 ‘추론’이라고 한다. 오늘날 인공지능을 처리하는 프로세서에도 이 용어는 똑같이 적용된다. 요컨대 프로세서의 학습 또는 추론, 우리는 이를 머신러닝(기계학습)이라고 불러 왔다.

◇양강 구도 깨뜨린 엔비디아 쿠다 코어

지난 수 십년간 연산용도로 사용될 수 있는 프로세서는 때로 적대적 기생관계로도 묘사되는 인텔과 AMD, 양사가 대표하는 x86 진영이 거의 독점적으로 공급해 왔다. 여기에 중대한 변화가 가해진 것이 약 10년 전의 범용 그래픽처리장치 (GPGPU) 의 등장이다. 엔비디아가 주도한 GPGPU의 흐름은 오늘날 머신러닝의 표준 언어와도 같은 쿠다(CUDA)의 정립으로 이어졌고, 그래픽처리장치 (GPU) 제조사로만 알려졌던 엔비디아는 순식간에 미래 컴퓨팅을 상징하는 선도회사 중 하나로 자리매김했다.

그래픽 처리에 특화된 GPU가 생뚱맞게도 머신러닝 시대에 각광받는 까닭은 GPU의 진화방향이 마침 머신러닝에 유리한 방향이었기 때문이다. 고해상도 디스플레이가 대중화되어 갈수록 GPU가 처리할 데이터의 양은 증가하는데, 화면에 특정 효과를 구현하는 작업의 중요한 특징은 픽셀 하나하나에 대하여 동일한 연산을 무수히 반복하는 경우가 많다는 것이다. 반면, 개별 픽셀에 서로 다른 효과(=연산) 를 무작위로 구현해야 할 경우는 드물다.

이에 따라, 자연스레 GPU는 해상도의 증가에 발맞춰 ‘병렬 처리’를 고도로 수행하게끔 진화하게 되었다. 반면 그와 대조적으로, CPU는 동일 연산을 반복적으로 수행하기보다는 복잡하고 다양한 연산을 수행하는 데 중점을 둬 왔는데, 오랜 기간 서로 다른 진화의 노선을 걸어온 이들이 때마침 시대의 화두로 급부상한 머신러닝을 맞아 희비가 극단적으로 엇갈렸으니 대단한 운명의 장난이지 않은가.

여기에 재차 변화의 물결이 다가오고 있으니, 바로 머신러닝의 성능을 획기적으로 높일 수 있는 텐서(Tensor) 연산의 대두이다. 행렬연산의 일종인 텐서는 ‘동일 연산 반복 수행’의 극단적인 예로, 이제부터는 텐서를 연산하기 위해 프로세서가 차라리 ‘진화’ 아닌 ‘퇴화’를 선택해야 할 정도로, 노선 변화의 갈림길에 놓이게 되었다.

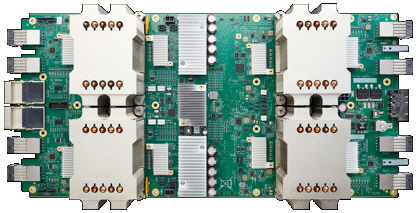

GPU가 범용 연산을 처리할 수 있게 된 것이 GPU 기반 머신러닝이라는 꽃을 피웠다면 이제 다시 ‘극단적으로 단순화된’ 반복작업을 위해 ‘범용성’을 포기해야 할 시기가 도래한 것이다. 엔비디아는 전통의(?) 머신러닝 명가답게 이에 대한 솔루션을 가장 먼저 제시했다. 바로 범용 연산 유닛에 더해 별도의 텐서 전용 유닛을 나란히 탑재한 것이다. 이 GPU의 이름은 ‘볼타’ 이다. 그러나 이질적인 두 유닛간의 시너지, 즉 ‘케미’ 없는 물리적 결합이란 점에서 면적의 비효율적 증가는 우려되는 점으로 꼽힌다. 볼타는 현재까지 하위 라인업으로 파종되지 않았다.

|

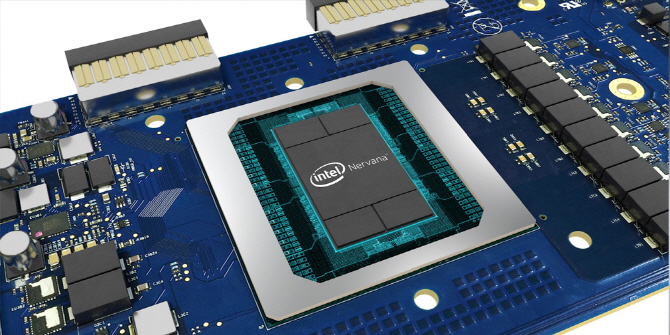

◇너바나 인수한 인텔의 반격

인텔은 오는 연말 자신이 인수했던 기업 너바나와 동명의 신경망 프로세서 (NNP) 를 발표할 계획이다. 여기까지만 보면 엔비디아 홀로 ‘비효율적’ 구세대 연산 유닛과의 공존을 꾀한 것 같지만, 인텔의 길은 엉뚱하게도 작년 인수합병 당시 아미르 너바나 공동창업자의 인터뷰에서 그 단서를 찾을 수 있다. 그리고 그 길은 인텔 역시 궁극적으로 CPU와 NNP의 융합에 방점을 찍고 있음을 보여 준다.

“앞으로 5년 뒤에는 우리 모두가 단순히 더 많은 FLOPS 성능을 요구하는 하드웨어 경쟁에서 벗어나, 실제로 AI를 구동하기 위해 신경망을 중심으로 하드웨어의 통합이 일어날 것이다. (중략) 하나는 제온과 같은 CPU 구성요소일 것이고, 또 하나는 NNP가 될 것이다. CPU와 NNP가 통합되면 구글 알파고에 사용되는 기술을 더욱 효율적으로 구현할 수 있다. 결국 너바나와 제온이 하나의 칩 위에 긴밀하게 통합될 것이라는 게 내 예측이다.”

때마침 인텔은 이번 분기 제온 스케일러블 프로세서 제품군을 출시하며, 그보다 더 거슬러 오르자면 지난해 4분기에 제온 파이 제품군을 출시하며 공히 알테라의 FPGA와 하나로 패키징된 제품이 언젠가 등장할 것임을 지속적으로 암시해 왔다. 어쩌면 인텔과 엔비디아의 길은, 길게 보면 다시 만나게 되는 것 아닐까.

|

![[포토]한덕수 대통령 권한대행 국무총리 탄핵소추안 투표하는 우원식 국회의장](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700978t.jpg)

![[포토] 달러 상승 이어져...](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700871t.jpg)

![[포토] 헌법재판소 소심판정](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700760t.jpg)

![[포토] 정청래 단장과 김이수 전 헌법재판관](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700742t.jpg)

![[포토] 윤석열 법률대리인 헌재 출석](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700731t.jpg)

![[포토]내수경기활성화 민당정협의회 열려](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700609t.jpg)

![[포토]입장하는 이재명 대표](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700546t.jpg)

![[포토] 달려라~](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700515t.jpg)

![[포토]이재명 "한덕수·국민의힘 내란 비호세력 탄핵 방해로 민생 경제 추락"](https://image.edaily.co.kr/images/Photo/files/NP/S/2024/12/PS24122700363t.jpg)

![[포토]윤이나,후배 양성을 위해 2억원 기부했어요](https://spnimage.edaily.co.kr/images/vision/files/NP/S/2024/12/PS24122600088h.jpg)

![[단독]尹, 매머드급 탄핵심판 대리인단 구성…지원자 폭주](https://image.edaily.co.kr/images/vision/files/NP/S/2024/12/PS24122701048h.jpg)